Internet è diventato nel tempo il calderone per una molteplicità di contenuti, alcuni leciti ed altri illeciti. Se all’inizio si poteva sperare di reprimere quelli illegali, ben presto ci si è resi conto che sarebbe stato impossibile, che si trattava di un’utopia ma questi contenuti hanno rivelato molto della comunità degli internauti e forse vale la pena fare una riflessione in merito.

Principali elementi di criticità

La moderazione dei contenuti

I contenuti su internet sono scarsamente moderati: un’affermazione importante che difficilmente può essere contestata. È tanto vera questa affermazione che l’Unione Europea ha sentito di dover creare il Digital Service Act che, tra le altre cose, obbliga le “big tech” a controllare e moderare i contenuti pubblicati sulle loro piattaforme. C’è molto scetticismo al riguardo, soprattutto perché in questi anni sono stati tentati molti tipi di moderazione: quella interamente umana, per lo più abbandonata. Quella supportata da algoritmi automatici, che molte volte si è mostrata fallace e altre volte ha sconfinato nella censura ingiustificata. Poi c’è stata la “moderazione diffusa”, basata sulla comunità nella quale ogni membro online può segnalare contenuti inadeguati ma anche in questo caso le limitazioni sono molte, non ultimo la capacità di valutazione degli internauti e la loro disponibilità. Il problema è serio, i contenuti crescono molto più velocemente della capacità di moderazione. Nelle comunità digitali di medie e grandi dimensioni, in cui si pubblicano centinaia e migliaia di contenuti al giorno è inimmaginabile per un moderatore fare quest’attività gratuitamente con risultati soddisfacenti; nelle comunità più piccole, invece, è ancora possibile. Immaginando un post giornaliero, con 200 commenti a seguito, significa moderare circa 25 commenti l’ora, comunque un’attività a tempo pieno. Bisogna tenere presente che moderare non significa censurare. Moderare può significare:

- spostare un contenuto da una discussione ad un’altra perché più pertinente;

- valutare il contenuto e scegliere il tipo di intervento da fare;

- nei casi di censura, è necessario spiegarne le motivazioni a beneficio della comunità.

Moderare è un’attività molto complessa, di responsabilità, le cui modalità e i cui tempi cambiano a seconda dei contenuti e degli argomenti trattati.

L’aspetto culturale

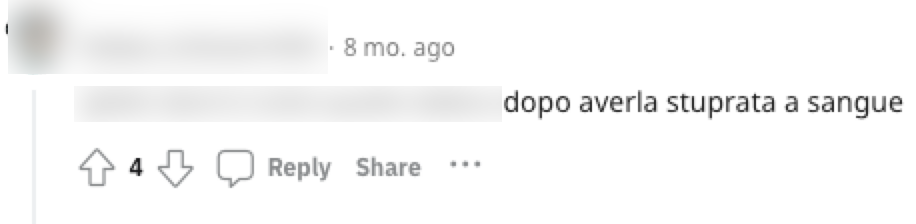

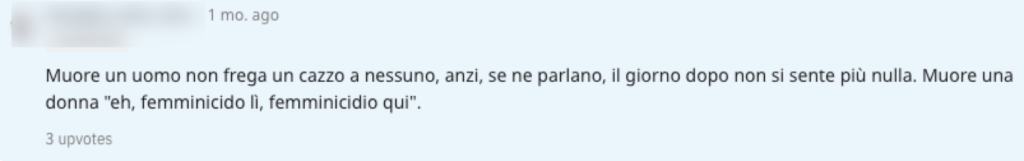

La necessità di moderazione nasce anche (ma non solo) dal mancato rispetto del rapporto umano. La Dottoressa Isabella Corradini, nella puntata di Lo-Ho Bit del 21 novembre 2023, ha detto una cosa molto interessante in merito al “recupero del significato delle relazioni“. Perché se in un primo momento i social network servivano a farci socializzare, oggi sono diventati qualcos’altro. Potremmo certamente definirli delle monadi nelle quali ci si rinchiude: delle monadi di consenso, delle monadi di notorietà, delle monadi d’importanza e, in definitiva, di potere. Questa ricerca di consenso, spesso, sfocia anche in atteggiamenti anti-sociali, condivisi e supportati da altri internauti: non è una novità trovare su internet numerosi post a sfondo sessuale, inneggianti allo stupro.

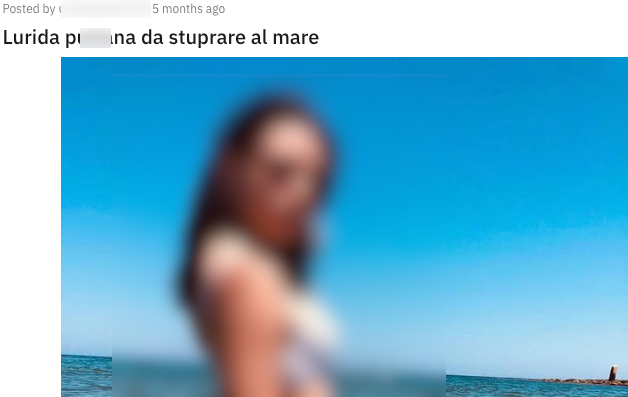

L’esempio mostrato nella foto seguente ritrae una normale ragazza che ha pubblicato la sua foto al mare sui social. Nella foto non è presente alcun tipo di contenuto esplicito. Indubbiamente la stessa non avrebbe mai immaginato di essere oggetto di commenti tanto turpi da parte della comunità digitale e immaginando per un momento di essere uno dei genitori di queste ragazze, potrebbero emergere sensazioni di disgusto, rabbia ma soprattutto di angoscia.

Il ruolo del sesso

Oggi molte persone denunciano che le foto messe su internet dai giovani si presentano come contenuti sessualizzanti: trasmettono un messaggio che ha a che fare con la sfera sessuale, con la sfera intima, con quella della seduzione. Se da una parte questa è un’affermazione assolutamente veritiera e riscontrabile, è altrettanto vero che dall’altra non è questo il fulcro delle molestie.

La scelta di mostrare una parte del corpo, un vestito succinto, o di lanciare un messaggio provocatorio, non deve essere il destro per spingere le persone a commettere stupri, violenze, insulti, o altre azioni aberranti. Se si ritengono disturbate, quelle persone hanno la libertà di non fruire di quei contenuti che, di fatto, non gli sono imposti dalla rete.

L’educazione sessuale, tasto assai dolente per l’Italia, andrebbe insegnata nelle scuole in modo da rendere consapevoli in merito ad un argomento così complesso e così sdoganato nel mondo virtuale ma anche in quello fisico. La necessità di legare il “bello” al “desiderabile” è un argomento che in Italia è stato discusso molte volte e ben rappresentato nel libro “Se nascerai donna” di Oriana Fallaci. Durante una delle interviste, quella a Barbara Steele, la Fallaci scrive:

Io escludo, Barbara, che il sesso sia per noi qualcosa di assopito, dimenticato. Se per le donne come Milly il sesso era un’arma, per noi è un’ossessione: non si fa che parlare di sesso, oggigiorno. Perfino la pubblicità è basata sul sesso: da quella per le gazose a quella per i trattori agricoli. Direi anzi, con Milly, che mai quanto oggi v’è stato un simile complesso del sesso.

Siamo passati dalla pubblicità delle gazose a quella del silicone, da quella sui cartelloni a quella online e il complesso del sesso, tanto denunciato dalla Fallaci, alla fine si è amplificato e oggi è diventato parte del problema della realtà digitale. Le foto delle giovani hanno, molto spesso, un rimando alla sensualità, al desiderabile ma anche accettando tale complesso, non è possibile né ammissibile giustificare alcuna reazione molesta nei loro confronti.

Un problema d’igiene digitale collettiva

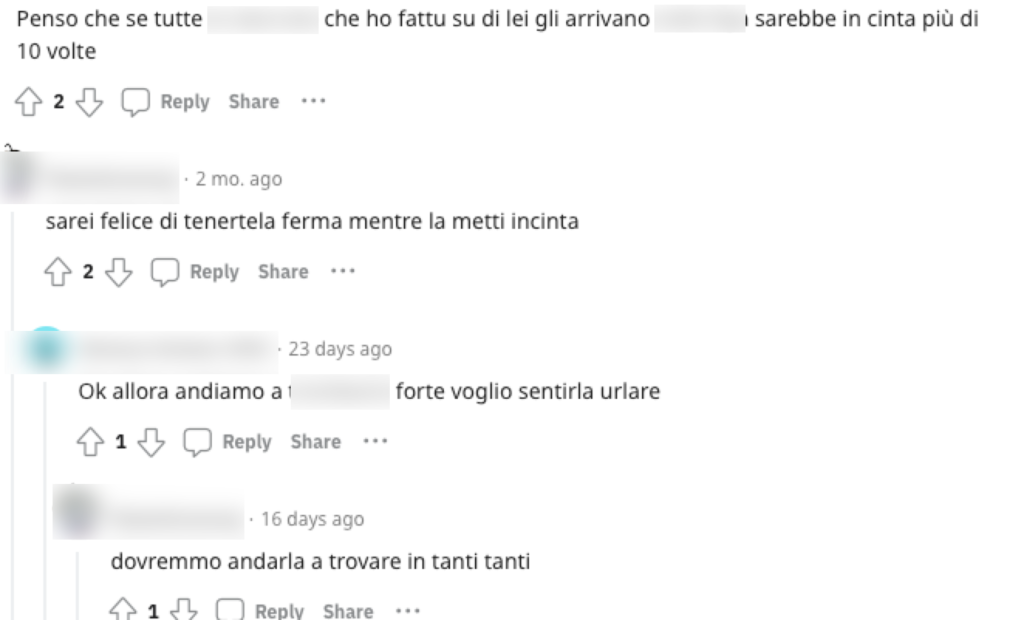

La moderazione dei contenuti è un problema collettivo: quando ci si imbatte in messaggi che inneggiano alla violenza, agli stupri, che innescano dinamiche di molestia, di bullismo, è necessario segnalare quei contenuti. Questo implica due attività: la prima da parte di chi segnala il contenuto, la seconda da parte di chi valuta e decide l’eventuale trasgressione. Certamente non è più pensabile affidare la moderazione ad una, due o cento persone su un social network: gli strumenti informatici di intelligenza artificiale possono esser addestrati a supportare i moderatori ma l’azione deve essere affidata alla collettività. Si tratta di un’operazione d’igiene dei contenuti, necessaria per mantenere la rete pulita da storture, estremismi e comportamenti anti-sociali. Sì, perché auspicare pubblicamente ad una persona di subire uno stupro, resta un comportamento anti-sociale. Aveva decisamente ragione Andrea Lisi: questo è il far web ormai ma spetta a noi rimettere ordine, perché siamo stati noi a creare il caos. Quello che viene riportato di seguito è un esempio di fomentazione e istigazione alla violenza dove si arriva ad augurare persino la lesione fisica della minore.

Anonimato e Web

C’è stata anche una trasformazione dell’anonimato su Internet: dapprima, agli albori della rete, era uno strumento creativo utilizzato per generare identità digitali mentre ora è divenuto anche un mezzo per occultare la propria identità allo scopo di tutelare e professare idee estreme e magari nemmeno troppo lecite ma c’è di più. Se inizialmente l’anonimato apparteneva esclusivamente al dominio dell’identità digitale, oggi la si sta sdoganando nella realtà fisica.

Di recente è stato pubblicamente presentato un libro scritto da un autore celato dal suo pseudonimo. Questa non è una novità nel mondo della scrittura ma durante la presentazione tale autore si è presentato all’evento con una maschera in volto per non farsi riconoscere. Questo autore, il cui pseudonimo non è importante al momento. ha scritto numerosi post particolarmente forti sui social e non sempre fondati. L’idea di presentarsi occultato in tutto e per tutto dietro una maschera e uno pseudonimo è stata, tra l’altro, legittimata da un quotidiano nazionale che ha sponsorizzato l’evento. Eppure l’accaduto dovrebbe sollevare una domanda legittima: se l’autore di queste idee è davvero convinto della loro genuinità, perché sente il desiderio di nascondersi dietro uno pseudonimo e una maschera?

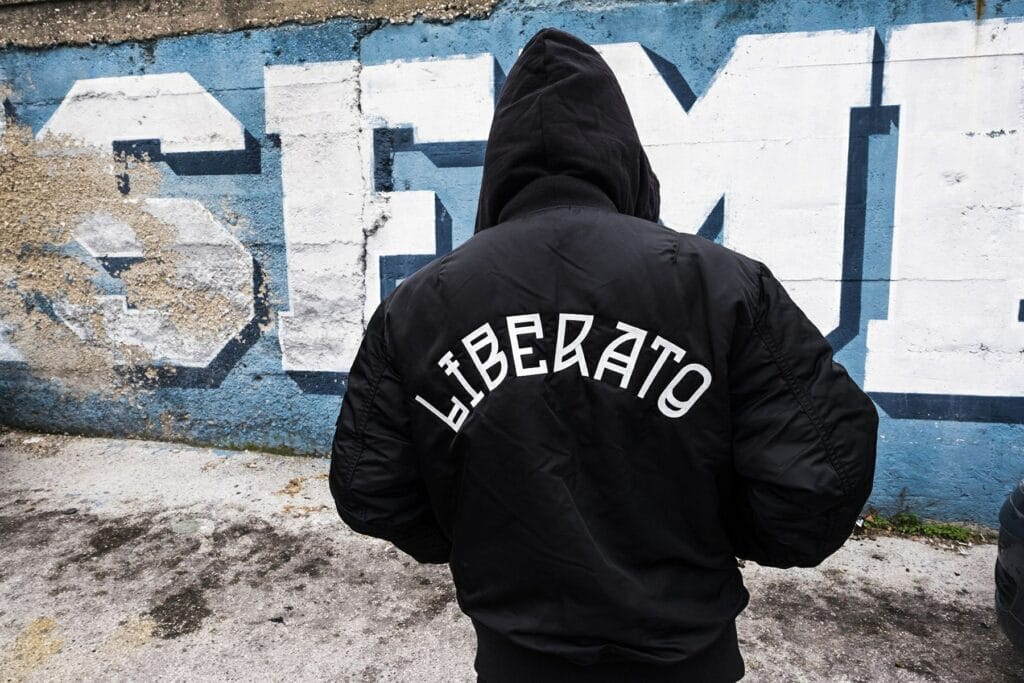

Non è una questione paragonabile a quanto avviene nello spettacolo con personaggi come Miss Keta o Liberato. La scelta artistica rientra in una serie di dinamiche che prediligono l’opera ed il suo significato sociale all’identità dell’artista. Ma nel caso riportato precedentemente, si ravvisa più la necessità di avere “una via di fuga” da contenuti che potrebbero improvvisamente divenire scomodi.

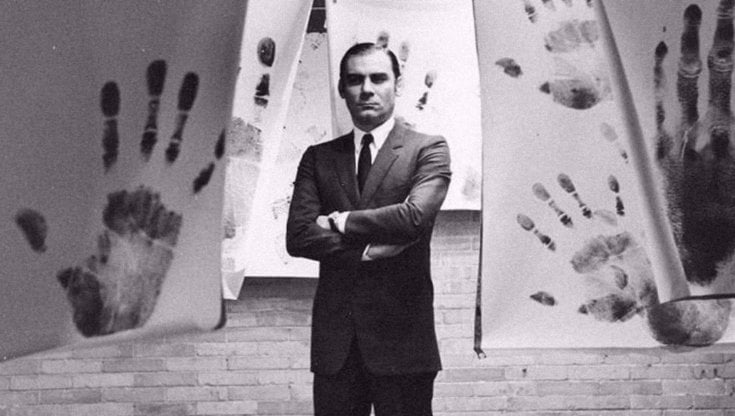

Non è quindi paragonabile l’anonimato di un artista come Banksy, all’anonimato utilizzato per scrivere post dal titolo “Lurida p***ana da stuprare“. Nel primo caso c’è la voglia di far concentrare lo spettatore sull’opera (sia esso un murales, o una canzone), nel secondo c’è la voglia di evadere dalle proprie responsabilità civili e penali.

Elementi di risoluzione e mitigazione

Formazione sì ma come?

L’unico modo per attenuare fortemente i rischi derivanti da comportamenti molesti, sessisti, discriminatori è educare. Educare al sesso, educare a Internet, educare al dialogo ma, soprattutto, educare ai rapporti umani. In un TED Talk di Padova, Margherita Tercon parla dell’esperienza capitata al fratello.

Damiano, rispetto alla sorella, ha un ritardo e questo ha reso la sua vita più difficile rispetto a quella di Margherita. Entrambi sono autistici e hanno portato su Internet la loro esperienza nella speranza di creare maggiore cultura al riguardo. Di seguito un estratto di un video nel quale Margherita spiega cosa è successo al fratello a scuola:

Lo avevano picchiato, trattato male, bullizzato, chiuso in un armadietto, preso a calci, gli avevano spaccato il naso con un pugno, lo avevano chiamato water, cesso, mongolo, ritardato, e lo avevano obbligato a ritirarsi da scuola per sopravvivere. E ogni suo tentativo di fare anche solo un piccolo passo in questo mondo veniva sabotato.

Margherita Tercon ha ragione: il sabotaggio di relazioni umane che potrebbero essere inclusive ma che, per ragioni di paura e potere, diventano esclusive è quanto di più frequente e spesso legittimato dai gruppi di molestatori. Da quelli che ormai si è ormai abituati a chiamare “il branco”. Ma non c’è sempre un branco, non c’è sempre un gruppo, a volte c’è un singolo e anche quello è in grado di ferire irrimediabilmente una persona.

Cultura, Stato e libertà di espressione

Byung-Chul Han ha ragione: “la shitstorm odierna, in crescita ovunque, dimostra che viviamo in una società priva di rispetto reciproco“. Non c’è dubbio in merito alla sua frase, ed il rispetto richiede una cultura che sin dalle origini della persona viene fornita dalla famiglia e dalle istituzioni. Eppure non sempre lo Stato, che incarna l’insieme delle istituzioni, è in grado di fornire una risposta adeguata.

Di strumenti ce ne sono tanti e quasi tutti sono garanti di sicurezza ma il problema non è strumentale; è più un problema di equilibrio tra regole e libertà. Quanti, ad esempio, sarebbero disposti ad accedere ad un social network accettando di essere identificati dallo Stato? A marzo 2023 il Corriere pubblicò un articolo in merito ad una proposta per limitare l’accesso ai social.

Il sottotitolo dell’articolo era: “Il Garante italiano per l’infanzia commenta: «Buona iniziativa ma sarebbe meglio alzare il limite a 16 anni e serve uno Spid per i minorenni»“.

Di iniziative come quella presentata dall’Italia e dalla Francia ce ne sono tante ma se da una parte esse proteggono l’individuo da un luogo complesso e pieno di stramberie, dall’altra non generano cultura. Offrono solo una limitazione e spesso è proprio la limitazione a generare il desiderio di commettere una violazione.

C’è da considerare che negli ultimi venti anni sono aumentate e di molto le piattaforme social. Quando si usa il termine social si è portati ad identificare alcuni servizi tra cui i più importanti sono certamente Twitter e Facebook ma negli ultimi venti anni se ne possono annoverare anche altri.

| Anno di Fondazione | Social |

| 2002 | |

| 2004 | |

| 2005 | Reddit YouTube |

| 2006 | |

| 2010 | |

| 2015 | Discord |

| 2016 | TikTok |

C’è stato quindi un aumento “orizzontale” della superficie dei social, oltre che un aumento “verticale” dei contenuti scritti. La scelta di imporre un divieto di accesso, piuttosto che un meccanismo di log-in (mediante identità digitale ad esempio), non è la soluzione. Certamente fornirebbe un supporto al perseguimento di un risultato ma non sarebbe di certo la soluzione.

Le VPN, la rete TOR, sono alternative con cui oggi è possibile accedere a piattaforme limitate o sospese da un paese (basti ricordare l’accesso tramite VPN a Chat GPT nel periodo di sospensione del Garante per la Protezione dei Dati). La scelta dell’identità digitale andrebbe fatta quindi “a livello mondiale” perché possa avere un determinato effetto, altrimenti basterà attivare uno di questi sistemi per aggirare il limite.

Non si deve quindi rischiare di confondere i piani: la soluzione deve intervenire molto prima che l’utente si sieda davanti al computer per scrivere qualcosa di aberrante ed è questa la difficoltà. Indubbiamente ci si può dotare di strumenti a supporto dell’identità (soprattutto per i minori) ma non si possono considerare delle soluzioni.

I mille volti della violenza

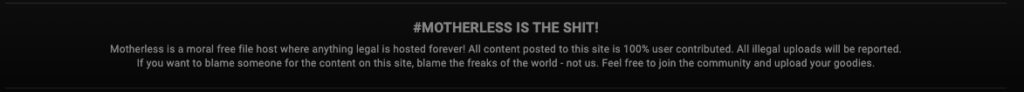

Inneggiare allo stupro, minacciare atti di violenza fisica e mentale, esprimere molestie, sono tutte situazioni deplorevoli ma sono illegali? Il sito Motherless raccoglie contenuti caricati dagli utenti purché siano legali, senza filtri di moralità. La scritta in calce riporta una frase interessante.

Motherless is a moral free file host where anything legal is hosted forever!

Motherless è un host di file privo di moralità in cui tutto ciò che è legale è ospitato per sempre!

Una filosofia che ha portato Motherless ad ospitare video di ogni sorta, prevalentemente di tipo pornografico e una visione molto simile è anche quella del portale Heavy-R (il nome sottintende “heavy rated” videos), dove vanno in scena video amatoriali di violenze, risse e abusi di varia natura. Ma è sicuro che un video senza moralità sia un video legale? Il pestaggio di uno studente, ripreso e pubblicato su queste piattaforme è un atto morale? è un atto legale? Perchè in queste piattaforme sono molti i video di questo tipo, tutti ben classificati e commentati con messaggi di “eguale moralità, come ad esempio:

These butches have to be undressed too and then thrown naked in a rapist paradise camp. With old stinky dirty men. These men have to rape them so long, until their brains understand, what emphaty is!

Anche queste puttane devono essere spogliate e poi gettate nude in un campo paradisiaco per stupratori. Con vecchi uomini sporchi e puzzolenti. Questi uomini devono violentarle così a lungo, finché il loro cervello non capisce cos’è l’empatia!

Conclusioni

La rete è nostra; la rete siamo noi, con i nostri messaggi e le nostre azioni. La violenza dilagante in rete deve essere moderata, segnalata ed è giusto pretendere un argine a questo fenomeno. Ma è indispensabile che ci si concentri soprattutto a prevenire queste azioni: è fondamentale che ci sia la formazione al giusto rispetto del rapporto umano, all’equità, al valore dell’altro.

È la cultura a mancare, la cultura del dialogo, la cultura dei rapporti umani come diceva Corradini, la cultura al sesso. La cultura non si ottiene con SPID, non si ottiene con la censura, non si ottiene con un firewall. La cultura si ottiene con la formazione, con modelli informativi corretti ma al momento l’Italia sembra non voler creare formazione. Molti slogan, pochi fatti. Il libro della Fallaci? È stato scritto prima del 2006 e pubblicato postumo (2019); forse è ora di fare qualcosa di politicamente e socialmente concreto e non solo indire fiaccolate.

Aggiornamento del 6 febbraio 2024

A seguito di un articolo pubblicato su “Il Foglio”, da parte del giornalista Luca Roberto si apprende che ci sarebbe un trattamento inefficace delle segnalazioni del revenge porn all’interno degli Uffici del Garante della Protezione dei Dati. Tale trattamento presenterebbe due criticità: la prima di natura tecnica e la seconda di natura organizzativa.

In merito alla prima il problema ruoterebbe intorno al fatto che le segnalazioni che il GdP farebbe alle piattaforme che ospitano i video incriminati, si baserebbe su un codice hash del file multimediale. Tuttavia questo codice hash non corrisponderebbe con quello contenuto nelle piattaforme, impedendo l’identificazione del video e la conseguente rimozione.

Il secondo problema è che le piattaforme non sono tenute a collaborare e infatti, dice il giornalista, non hanno dato alcun riscontro nel merito. I video sono quindi rimasti lì dov’erano ma nel frattempo i video si sono accumulati all’interno della banca-dati del Garante che, nel frattempo, si è dovuta dotare di una struttura tecnico-organizzativa apposita.

Il giornalista, tra l’altro, spiega che l’invio del materiale è spesso capzioso da parte di soggetti che si “divertirebbero ad intrattenere” le persone della commissione nella quale sono presenti anche donne. Ne parla anche il podcast “Morning” de “Il Post”, condotto da Francesco Costa, nella puntata del 6 febbraio 2024.