Esaminando le basi sociali dell’intelligenza artificiale, nonché i suoi legami con gli ambiti che la riguardano, ci si rende conto che è necessario fare una serie di riflessioni senza le quali è impossibile apprezzare la complessità del tema, e senza le quali si corre il rischio di commettere alcuni errori di valutazione. Vediamo di parlarne assieme.

Complessità

La definizione di intelligenza artificiale, spesso sintetizzata in un singolo significato, mal si sposa con la complessità degli ambiti in cui essa è calata. È lecito immaginare che gli ambiti di appartenenza siano essenzialmente i seguenti:

- Ambito filosofico

- Ambito psicologico

- Ambito sociologico

- Ambito giuridico

- Ambito economico

- Ambito informatico

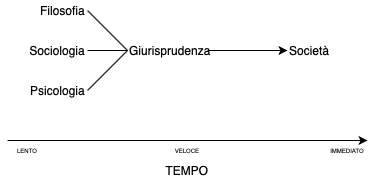

È però da notare che questi ambiti principali non sono tra loro tutti uguali: hanno cioè pesi differenti. Alcuni sono “puri”, mentre altri sono derivati dai primi. È il caso dell’ambito giuridico, nato per regolare le interazioni sociali, con origini filosofiche e sociali. Se provassimo a rappresentarlo in modo grafico potremmo raffigurarlo come segue.

La teoria della chiave

Immaginiamo di avere la possibilità di spegnere istantaneamente uno degli ambiti sopra riportati girando una chiave e supponiamo che l’ambito giuridico venga spento per primo. È facile supporre che nel giro di poche ore, senza un comparto giuridico atto ad ordinare la società, ci sarebbero violenze e reati causati da una fisiologica anarchia; il tempo di reazione sarebbe quindi molto veloce se non addirittura immediato.

Immaginiamo invece di spegnere uno degli ambiti più “puri” quale ad esempio la sociologia. La società rimarrebbe in ordine e il diritto continuerebbe a funzionare ma il blocco della sociologia causerebbe fisiologicamente un blocco nell’evoluzione sociale e delle discipline associate. È importante ricordare i principi stabiliti dalla dogmatica del diritto, tengono in considerazione meccaniche sociali proprie della sociologia. Vi sarebbe quindi una reazione a catena ma decisamente più lenta rispetto allo spegnimento del diritto. La lentezza causerebbe una stagnazione e un conseguente degrado dei principi fondanti su cui si basa il “prodotto giurisprudenza”.

Alcuni si domanderanno la necessità di includere la psicologia in ambiti di regolamentazione. Nel volume “Le scienze dell’uomo” di Jean Piaget, l’autore elenca quali elementi occorra conoscere per determinare l’apporto che la società ha sull’individuo. Al numero tre l’autore scrive:

I comportamenti sociali dell’adulto, nella dinamica dei gruppi o la vita collettiva in generale, comprese le innumerevoli condotte sociali interiorizzate e applicate al proprio io, secondo un ben noto processo.

Jean Piaget “Le scienze dell’uomo”

In sostanza Piaget ci spiega che la società e l’individuo si influenzano a vicenda attraverso dinamiche sociali basate su processi psicologici su cui, comprensibilmente, si fonda il diritto.

Ogni ambito sopra elencato è quindi un ecosistema autonomo, ma al contempo ciascuno è integrato nell’altro ed il diritto ha proprio la funzione di regolarne le interazioni. C’è quindi una dimensione “verticale” in cui ogni contesto si sviluppa e una dimensione “orizzontale” attraverso la quale i contesti interagiscono.

La relazione tra ETICA e I.A.: il test della Kobayashi Maru

Nell’interessante libro “Etica delle macchine. Dilemmi morali per robotica e intelligenza artificiale” di Tamburrini ci si pone il problema della logica d’impatto dei veicoli a guida autonoma: tra due ciclisti, uno con il casco ed uno senza casco, quale sarà il bersaglio che il veicolo a guida autonoma dovrà colpire in caso di collisione obbligata?

È chiaro che il pensiero andrà al ciclista con il casco, perchè eticamente siamo portati a pensare che riporterà meno danni al momento dell’impatto e anche nel periodo immediatamente successivo di convalescenza; il nostro ragionamento si basa sulla mitigazione delle conseguenze. Sul lungo periodo tuttavia è possibile che questo dia adito ai ciclisti a ritenere più proficuo non indossare per nulla il casco in quanto non sarebbero “scelti” dai veicoli a guida autonoma in situazione di collisione imminente. Ma allora qual è la risposta giusta? Non c’è una risposta giusta; si tratta di quello che nella serie Star Trek viene conosciuto come il test della Kobayashi Maru.

Nella simulazione i cadetti hanno i ruoli di ufficiali di plancia e stanno pattugliando la Zona Neutrale Klingon; viene ricevuta una chiamata di soccorso dall’astronave Kobayashi Maru, una nave da carico civile che ha colpito una mina gravitazionale. Nei pressi della nave in pericolo, si stanno posizionando anche gli incrociatori Klingon. Il comandante della nave soccorritrice deve decidere se salvare la Kobayashi Maru, violando il trattato con i Klingon entrando nella Zona Neutrale e ingaggiando una battaglia, o abbandonare la nave al suo destino. In entrambi i casi non c’è possibilità di vittoria.

Ritenere che l’intelligenza artificiale non incorra in errore è sbagliato. L’errore è sempre presente nel ragionamento dell’uomo e della macchina perchè è insito nel contesto di realtà. La differenza fondamentale è che l’intelligenza artificiale ha una velocità di calcolo superiore rispetto a quella umana e non soffre di quella tipologia di “rumore” tipicamente attribuibili all’essere umano (stanchezza, emotività, etc…).

Il rapporto tra società, crimine e intelligenza artificiale

C’è una pubblicazione del 1968 a cura di Leon Radzinowicz (criminologo britannico nonché direttore e fondatore dell’Istituto di Criminologia presso la Facoltà di Giurisprudenza dell’Università di Cambridge.) che sul crimine ha detto due cose molto affascinanti.

“Il reato può essere eliminato?[…] Da un lato vi era un certo disappunto per il fatto che fosse stato ottenuto così poco in questo campo[…] Dall’altro lato, un esame distaccato del reato […] aveva indotto alla asserzione che il delitto dovesse essere accettato quale fatto sociale normale e persino utile”

— Leon Radzinowicz

Se l’intelligenza artificiale dovrà curarsi della lotta al crimine, sarà necessario chiarire prima l’aspetto sollevato da Radzinowicz. L’utilità del reato ha molte chiavi d’interpretazione, una delle quali strettamente collegate a fenomeni collegati alla cultura del paese in cui il reato è connesso. Quetelet si era avvicinato alla definizione di “numero oscuro”, ossia di quei crimini che vengono ignorati per ragioni varie ed in parte legate alla “normalità culturale” del contesto in cui essi sono prodotti.

Ciò significa che qualsiasi algoritmo di intelligenza artificiale, per operare in modo armonico con la società e al contempo, nel rispetto della vita umana, dovrà essere progettato rispondendo prima al quesito di Radzinowicz.

Il reato può mutare forma quando muta la società, ma rimaner pur sempre un aspetto costante di tutte le società, qualunque siano le condizioni razziali, nazionali, sociali, morali ed economiche.

Anche Emile Durkheim trovò compatibile la visione utilitaristica del reato seppur antagonizzato da Enrico Ferri e Gabriel Tarde.

Conclusioni

Il problema etico rapportato all’intelligenza artificiale e alla società civile orienta imprese e istituzioni ad approfondire la tematica. Nuove discipline e nuove facoltà stanno nascendo per stabilire la giusta correlazione tra etica e intelligenza artificiale. Nel 2019 la Technical University of Munich (TUM) ha fondato un istituto denominato “Institute for Ethics in Artificial Intelligence”. L’istituto vede, tra l’altro, la partnership con Facebook che ha donato 7.5 milioni di dollari distribuiti su 5 anni per studiare le interazioni tra etica e intelligenza artificiale. Non credo serva aggiungere altro.

Riferimenti bibliografici

“Etica delle macchine. Dilemmi morali per robotica e intelligenza artificiale”, Guglielmo Tamburrini, Editore Carocci, 2020

“Facebook and the Technical University of Munich Announce New Independent TUM Institute for Ethics in Artificial Intelligence”, Facebook NewsRoom, 2019

“Le scienze dell’uomo”, Jean Piaget, Editore Universale Laterza, 1973

“Ideologia e Criminalità. Uno studio del diritto nel suo contesto storico e sociale.”, Leon Radzinowicz, Editore Giuffrè, 1968